动手学深度学习-李沐

OpenAI 和 Anthropic 人员结构图

| 类别 |

OpenAI(约 7200 人) |

Anthropic(约 2300–2500 人) |

| 研究 & 基础研发 |

~30% (~2,100–2,200) |

~30% (~700–750) |

| 工程 & 基础设施 |

~25% (~1,800) |

~25% (~575–625) |

| 产品 & 商业化 |

~15% (~1,080) |

~15% (~350–375) |

| 数据工程 & 数据治理 |

~10% (~720) |

~10% (~230–250) |

| 安全 / 对齐 |

~10% (~720) |

~15% (~350–375) |

| 运营 / 非技术 |

~10% (~720) |

~5–10% (~115–250) |

数据来源

- OpenAI 的数据策略是 “大力出奇迹”:通过海量资金买断全球媒体资源,配合强大的合成数据流水线,追求模型的广度和多模态能力。

- Anthropic 的数据策略是 “精耕细作”:通过宪法 AI 生成极其干净的合成数据,配合高水平的人类专家反馈,追求模型的深度和安全性。

2026 年全球 AI 巨头资本支出计划对比表

| 巨头类别 |

公司名称 |

2026年预计支出 (USD) |

支出性质与核心投向 |

市场信号 / 备注 |

| 云基建巨头 |

Amazon (AWS) |

~$2,000 亿 |

全球数据中心扩建、自研芯片 (Trainium 3)、核能电力买断。 |

规模之王:支出规模已超越多数中型国家年度基建。 |

| 云基建巨头 |

Alphabet (谷歌) |

~$1,800 亿 |

TPU v6/v7 量产、Gemini 系列研发、深层地热能等绿色基建。 |

全栈闭环:试图在芯片、模型、能源上实现完全自给。 |

| 社交/开源巨头 |

Meta (脸书) |

~$1,300 亿 |

Llama 5 训练、万亿级参数集群维护、大规模采购 AMD 芯片。 |

开源杠杆:通过高额支出维持开源霸权,降低 AI 行业门槛。 |

| 软件/云巨头 |

Microsoft |

~$1,150 亿 |

Azure AI 全球节点、Stargate (星际之门) 项目、OpenAI 专属算力。 |

战略金主:作为 OpenAI 的“算力银行”,重点在于生态绑定。 |

| 独角兽 (巨舰) |

OpenAI |

~$170 - 200 亿* |

推理成本优化、下一代前沿模型 (o3/o4) 训练、人才激励 (SBC)。 |

战术调整:2026年开始下调远期预期,转向追求高 ROI。 |

| 独角兽 (精锐) |

Anthropic |

~$100 - 120 亿* |

Claude 4 系列研发、企业级 Agent (Claude Code) 快速部署。 |

人效冠军:营收增长极快 (ARR $140亿),亏损率正大幅收窄。 |

*注: 对于非上市的 OpenAI 和 Anthropic,该项反映的是其年度现金支出(Cash Burn),主要流向为向微软/亚马逊/谷歌租赁算力的费用。数据基于 2026 年 Q1 财报指引及行业调研。

2026 年 AI 芯片来源比例分布表

| 厂商名称 |

自研芯片比例 (约) |

主要采购来源 |

自研芯片代号与用途 |

| Alphabet (谷歌) |

~55% |

NVIDIA, Broadcom |

TPU v6 / v7:承担谷歌内部 90% 以上训练与推理任务,自给率全球最高。 |

| Amazon (AWS) |

~40% |

NVIDIA, AMD |

Trainium 3 / Inferentia 3:大规模部署,面向 Anthropic 及 AWS 云客户提供训练与推理服务。 |

| Meta (脸书) |

~25% |

NVIDIA, AMD |

MTIA v2 / v3:主要用于推荐系统和广告算法;LLM 训练仍高度依赖 NVIDIA GPU。 |

| Microsoft |

~20% |

NVIDIA, AMD |

Maia 200:用于 Azure 内部服务及部分 OpenAI 推理任务;起步较晚但增长较快。 |

| OpenAI |

~5% |

NVIDIA(主), AMD |

自研项目(未公开):目前 95% 以上算力仍依赖 NVIDIA;2026 年开始增加 AMD 采购。 |

| Anthropic |

~15% |

Google (TPU), AWS |

不直接自研硬件;通过适配 TPU 与 Trainium 降低对 NVIDIA 依赖。 |

OpenAI VS Anthropic 硬件策略

| 维度 |

OpenAI 的做法 |

Anthropic 的做法 |

| 显卡获取 |

举债 / 融资,大规模向 NVIDIA 直接采购。 |

接受巨头投资,直接使用巨头的云算力。 |

| 芯片种类 |

主要是 NVIDIA(90% 以上)。 |

三足鼎立:NVIDIA + Google TPU + AWS Trainium。 |

| 财务影响 |

负债率高,资本支出(CapEx)巨大。 |

人效比极高,营收(ARR)与开支比例健康。 |

Anthropic 股权结构

| 股东类别 |

代表机构 |

估算持股比例 (约) |

角色与性质 |

| 战略科技巨头 |

Amazon (亚马逊) |

~8% - 10% |

最大单一战略股东,累计投入超 $80 亿,用于算力与生态布局。 |

| 战略科技巨头 |

Google (Alphabet) |

~12% - 14% |

早期进入,总投入约 $30 亿,包含大量云抵扣券,提供基础设施支持。 |

| 战略科技巨头 |

Microsoft & NVIDIA |

~4% - 6% |

2025-2026 年间新入场,主要为算力合作与生态占位。 |

| 机构领投方 |

GIC (新加坡主权基金) |

~5% - 7% |

Series G 领投方,目前最活跃的长期财务投资人。 |

| 机构领投方 |

Coatue & MGX |

~5% |

阿联酋背景的 MGX 进场,标志着主权资本对 AI 的争夺。 |

| 创始人与员工 |

Amodei 兄妹及核心团队 |

~15% - 20% |

虽经多次稀释,但通过 A/B 股及信托保留核心决策权。 |

| 早期 VC 与其他 |

Founders Fund, Spark 等 |

~剩余部分 |

包含数十家硅谷顶级风投及早期机构投资者,提供早期资金与战略建议。 |

Anthropic 是典型的“多方分权制”,亚马逊和谷歌相互制衡,安全性由外部信托控制

OpenAI 股权结构

| 股东类别 |

代表机构 |

估算持股比例 |

估算价值 (基于 $830B 估值) |

权利与性质 |

| 主导投资方 |

Microsoft (微软) |

~27% |

~$2,240 亿 |

核心战略伙伴,拥有模型 IP 永久授权(至 2032 年)。 |

| 非营利母体 |

OpenAI Foundation |

~26% |

~$2,150 亿 |

控制权核心:保留任命董事会的权利,拥有超额认股权证。 |

| 员工与管理层 |

Sam Altman 及核心团队 |

~15% - 20% |

~$1,200 - 1,600 亿 |

包含 2026 年 2 月刚开启的员工套现计划。 |

| 最新战略投资者 |

NVIDIA (英伟达) |

~4% - 5% |

~$300 - 400 亿 |

2026 年 2 月通过 300 亿美金直接注资获得股份。 |

| 全球资本盟友 |

SoftBank, Thrive, GIC |

~剩余部分 |

~$1,800 亿 |

多为 2025 年大额融资进入,支持 IPO 进程。 |

OpenAI 是典型的“中心集权制”,虽然非营利基金会在法律上控制董事会,但 Sam Altman 和 微软 构成了实际的业务驱动轴心

复杂的交叉持股

| 核心投资方 |

被投 / 合作方 |

投资性质 |

战略目的 |

| NVIDIA (英伟达) |

OpenAI / Anthropic |

股权投资 + 算力优先权 |

“锁定下游”:确保顶级实验室长期使用 NVIDIA 架构,构建硬件护城河。 |

| Microsoft (微软) |

OpenAI / Anthropic |

股权投资 + 算力抵扣 |

“多头下注”:重仓 OpenAI 的同时入股 Anthropic,降低对单一供应商依赖。 |

| Amazon (亚马逊) |

Anthropic |

深度控股级投资 |

“算力消化”:让 Anthropic 成为 AWS 自研芯片(Trainium)的最佳实验场。 |

| OpenAI / AMD |

相互持股 / 认股权证 |

芯片换股权 |

“去英伟达化”:OpenAI 获得 AMD 股份,作为使用 AMD 芯片激励,联合对抗 NVIDIA。 |

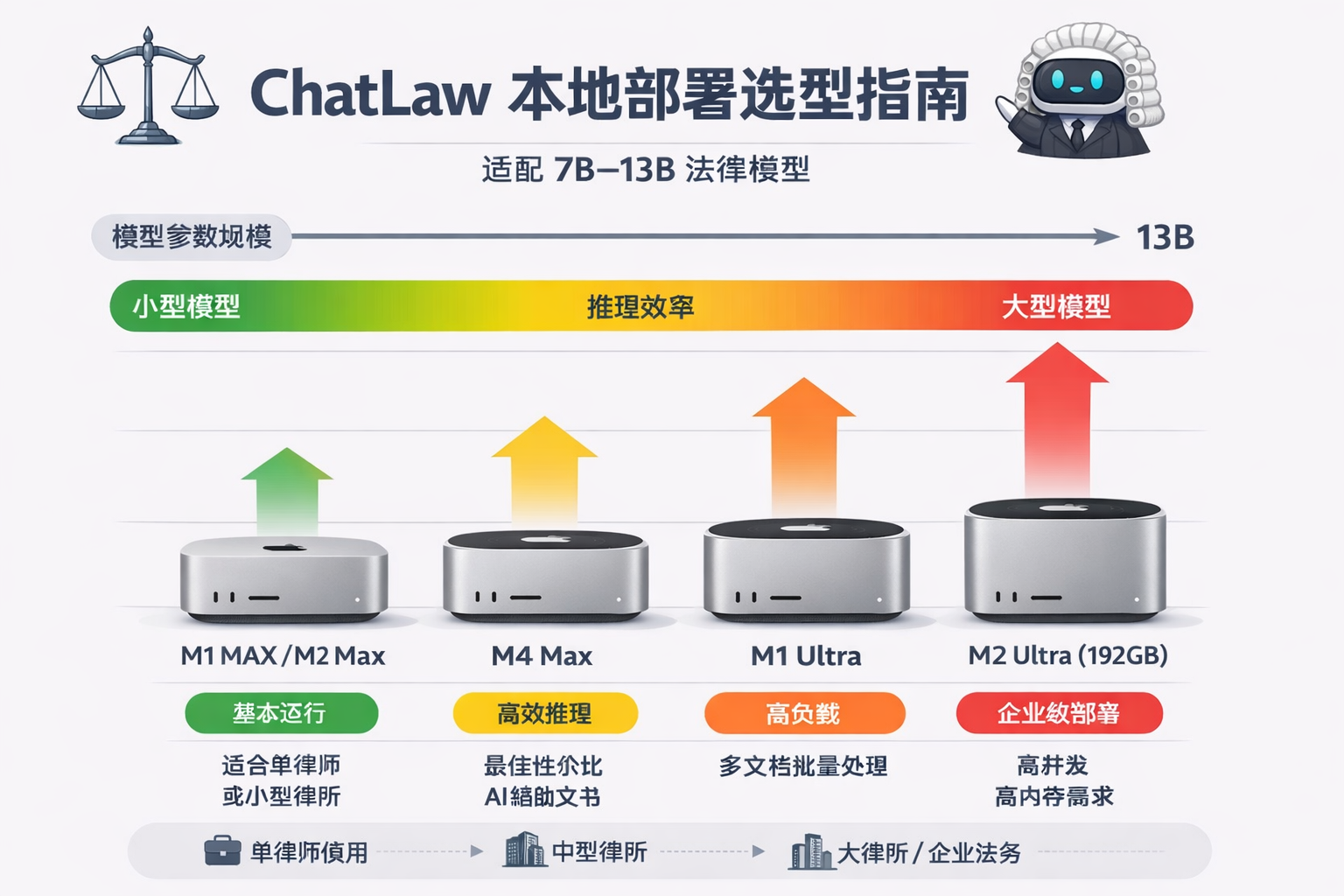

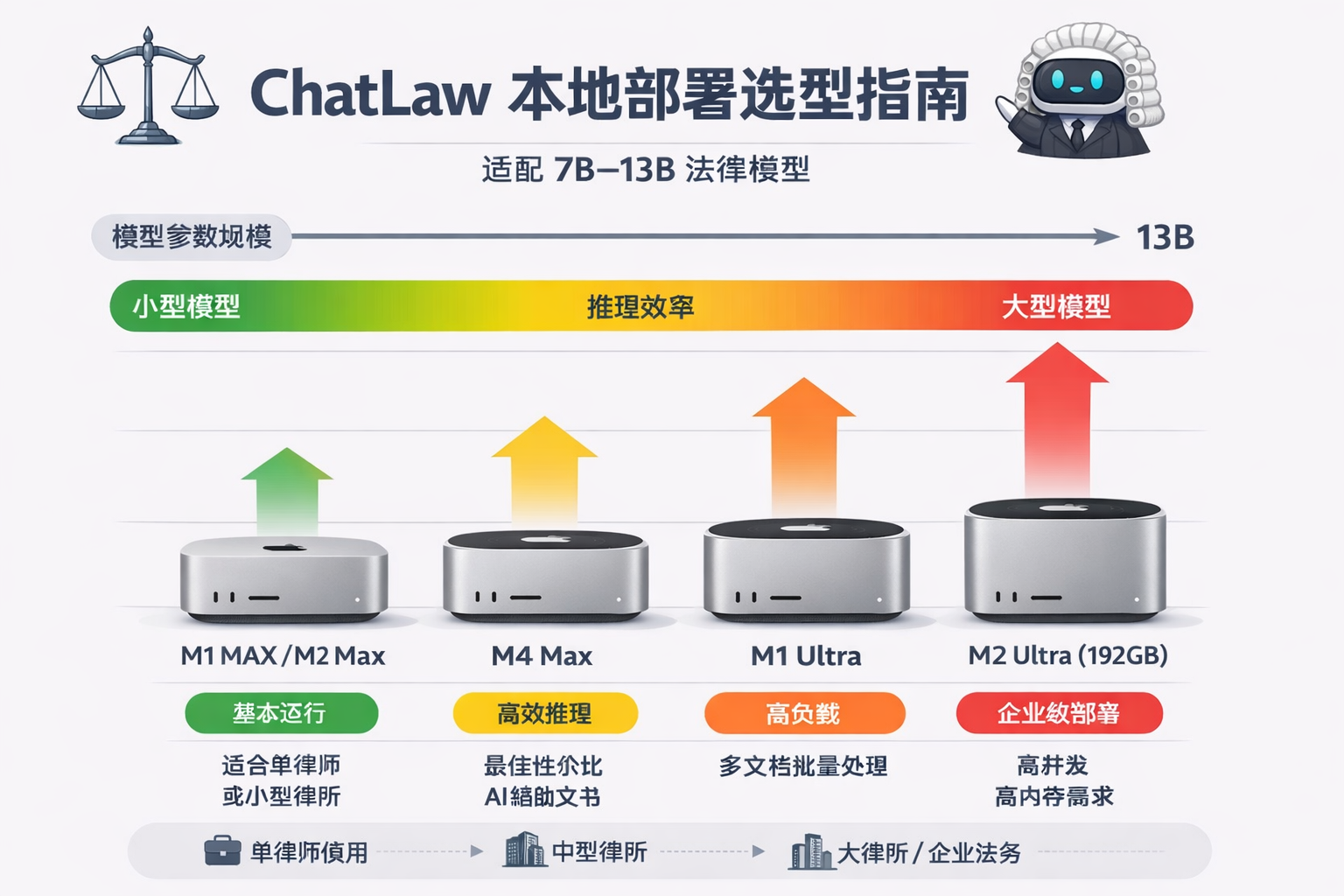

Mac Studio 的发布历史

| 型号 |

CPU 核心 |

GPU 核心 |

最大统一内存 |

内存带宽 |

定位 |

| M1 Max (2022) |

10 |

24–32 |

64GB |

400GB/s |

初代高性能 |

| M1 Ultra (2022) |

20 |

48–64 |

128GB |

800GB/s |

首代旗舰 |

| M2 Max (2023) |

12 |

30–38 |

96GB |

400GB/s |

性能升级 |

| M2 Ultra (2023) |

24 |

60–76 |

192GB |

800GB/s |

专业旗舰 |

| M4 Max (2025) |

14–16 |

32–40 |

128GB+ |

500GB/s级 |

AI 优化新架构 |

对单律师或小律所,M4 Max 就够用;需要高并发、多文档处理或企业内部部署,选择 M2 Ultra 最稳妥

部署 ChatLaw 硬件性能对比表

| 维度 |

Mac Studio (Ultra) |

NVIDIA DGX Spark |

| 可运行模型规模 |

33B+(满血) |

33B(高性能) |

| 检索响应 (RAG) |

⭐⭐⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

| 推理速度 (TPS) |

⭐⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

| 系统兼容性 |

macOS(法律软件需适配) |

Windows / Linux(极好) |

| 部署难度 |

简单(图形化工具 + macOS生态) |

较高(依赖 Docker / CUDA) |

| 价格区间 |

$3999+(高配更贵) |

$3999–$4299(标准版) |

参数对比

| 维度 |

Mac Studio Ultra |

NVIDIA DGX Spark |

| 定位 |

专业工作站 |

企业级 AI 推理超算 |

| CPU |

Apple Silicon(多核心高效能) |

多路 x86 服务器 CPU |

| GPU 架构 |

Apple GPU + Neural Engine |

NVIDIA GPU (Ampere / Hopper/Blackwell) |

| AI 加速单元 |

Neural Engine + Metal + GPU |

CUDA + Tensor Cores + NVLink |

| 最大统一内存 |

192 GB(可选) |

各卡内存总和(数百 GB+) |

| 显存总量 |

依统一内存共享 |

多 GPU 独立显存(≥ 80 GB / 卡 x 多卡) |

| 推理吞吐能力(相对) |

⭐⭐⭐⭐(高) |

⭐⭐⭐⭐⭐⭐(更高) |

| 可支持模型规模 |

33B+(满血,本地) |

33B+(高性能,多卡并行) |

| 推荐场景 |

单机大模型推理 / AI 办公 |

企业级集群推理 / 多用户并发 |

| 系统兼容性 |

macOS + Metal |

Linux + CUDA / Kubernetes |

| 部署复杂度 |

⭐⭐(简单) |

⭐⭐⭐⭐(复杂) |

| 典型价格区间 |

~$4000+ |

~$4000–$4300 / 单节点(不含集群) |

NVIDIA DGX Spark是被美国出口管制的

合规风险: 即使您通过灰色渠道买到了 DGX Spark,未来其内置的 DGX OS(基于 Ubuntu 的专用系统)在更新驱动或访问 Nvidia 企业级 AI 库时,可能会因为 IP 识别而遭到封锁。替代方案: 如果您所在的律所对合规性要求极高,Mac Studio M4/M5 Ultra 是目前风险最小的高端选择。